决策树

作者:互联网

一个决策树 是一种决策支持工具,它采用了树状 模型的决定及其可能产生的后果,包括偶然事件的结果,资源成本和效用。它是显示仅包含条件控制语句的算法的一种方法。

决策树通常用于运营研究,特别是决策分析,以帮助确定最有可能达到目标的策略,但也是机器学习中的流行工具。

内容

概述[ 编辑]

决策树是类似于流程图的结构,其中每个内部节点表示对属性的“测试”(例如,硬币翻转是否出现在头部或尾部),每个分支代表测试的结果,并且每个叶节点表示class label(在计算所有属性后做出的决定)。从根到叶的路径表示分类规则。

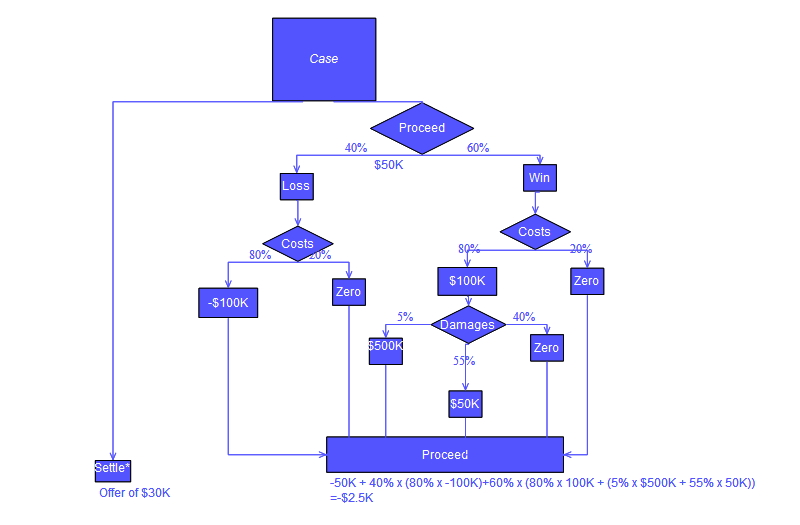

在决策分析中,决策树和密切相关的影响图被用作视觉和分析决策支持工具,其中计算竞争备选方案的预期值(或预期效用)。

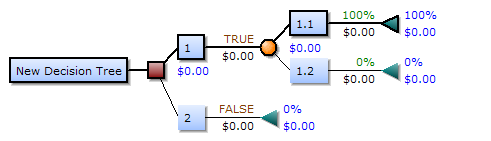

决策树由三种类型的节点组成:[1]

- 决策节点 - 通常由正方形表示

- 机会节点 - 通常由圆圈表示

- 结束节点 - 通常由三角形表示

决策树通常用于运营研究和运营管理。如果在实践中决策必须在线进行而不是在不完全知识下进行召回,则决策树应与概率模型并行作为最佳选择模型或在线选择模型算法。一种用途是作为计算条件概率的描述性手段。

决策树,影响图,效用函数和其他决策分析工具和方法被教授给商业,卫生经济学和公共卫生学院的本科学生,并且是运筹学或管理科学方法的例子。

决策树构建块[ 编辑]

决策树元素[ 编辑]

从左到右绘制,决策树仅具有突发节点(分裂路径)但没有汇聚节点(会聚路径)。因此,手动使用,它们可以变得非常大,然后通常很难用手完全绘制。传统上,决策树已经手动创建 - 如旁边的示例所示 - 尽管越来越多地使用专门的软件。

决策规则[ 编辑]

决策树可以线性化为决策规则,[2]其中结果是叶节点的内容,沿路径的条件在if子句中形成一个连接。一般来说,规则的形式如下:

如果 condition1 和 condition2 和 condition3 然后结果。

可以通过在右侧构建具有目标变量的关联规则来生成决策规则。它们也可以表示时间或因果关系。[3]

使用流程图符号的决策树[ 编辑]

通常使用流程图符号绘制决策树,因为许多人更容易阅读和理解。

分析示例[ 编辑]

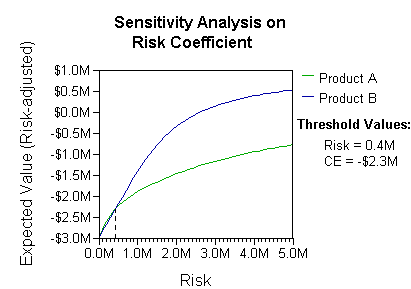

在这种情况下的基本解释是,公司更倾向于B风险和实际风险偏好系数下的收益(超过40万美元 - 在该风险规避范围内,公司需要建立第三种策略,“A和B都不是”) 。

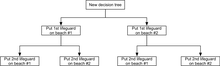

另一个通常用于运营研究课程的例子是在海滩上分发救生员(又名“生活在海滩”的例子)。[4]该例子描述了两个带救生员的海滩,分布在每个海滩上。最高预算B可以在两个海滩之间分配(总计),并且使用边际回报表,分析师可以决定为每个海滩分配多少救生员。

| 每个海滩上的救生员 | 总共阻止了溺水,海滩#1 | 总共阻止了溺水,海滩#2 |

|---|---|---|

| 1 | 1 | 3 |

| 2 | 4 | 0 |

在这个例子中,可以绘制决策树来说明在#2海滩上收益递减的原则。

海滩决策树

决策树说明,当顺序分配救生员时,如果只有1名救生员的预算,将第一救生员放在海滩#1上将是最佳的。但是如果有两名警卫的预算,那么将两者放在#2海滩上可以防止更多的整体溺水。

救生员

影响图[ 编辑]

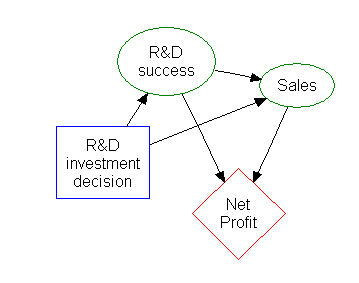

决策树中的大部分信息可以更紧凑地表示为影响图,将注意力集中在事件之间的问题和关系上。

左侧的矩形表示决策,椭圆表示操作,菱形表示结果。

关联规则归纳[ 编辑]

决策树也可以被视为来自经验数据的归纳规则的生成模型。然后将最优决策树定义为占大多数数据的树,同时最小化级别(或“问题”)的数量。[5]已经设计了几种生成这种最佳树的算法,例如ID3 / 4/5,[6]CLS,ASSISTANT和CART。

优点和缺点[ 编辑]

在决策支持工具中,决策树(和影响图)具有几个优点。决策树:

- 很容易理解和解释。经过简短的解释,人们能够理解决策树模型。

- 即使只有很少的硬数据也有价值。可以基于描述情况(其替代方案,概率和成本)的专家及其对结果的偏好来生成重要见解。

- 帮助确定不同方案的最差,最佳和预期值。

- 使用白盒模型。如果给定结果由模型提供。

- 可以与其他决策技术结合使用。

决策树的缺点:

- 它们是不稳定的,这意味着数据的微小变化可能导致最优决策树结构的巨大变化。

- 它们通常相对不准确。许多其他预测因子使用类似数据表现更好。这可以通过用决策树的随机森林替换单个决策树来解决,但随机森林不像单个决策树那样容易解释。

- 对于包括具有不同级别数的分类变量的数据,决策树中的信息增益偏向于具有更多级别的那些属性。[7]

- 计算可能变得非常复杂,特别是如果许多值不确定和/或许多结果是相关的。

标签:决策,海滩,决策树,节点,转存,救生员 来源: https://blog.csdn.net/qq_24624539/article/details/90320775

转存失败

转存失败